生成AIの便利さはわかっていても、ニュースで耳にする「AIの嘘(ハルシネーション)」や「情報漏洩」のリスクを前に、導入のブレーキを踏んでしまう企業は少なくありません。特に企業の公式窓口としてAIを使う場合、一回の誤回答がブランド毀損やトラブルに直結する懸念があるのは当然です。

しかし、現在のAI技術、特にビジネス向けに設計されたツールには、こうしたリスクを技術的に封じ込める仕組みが備わっています。本記事では、生成AI特有のデメリットとハルシネーションの正体を解説した上で、企業が安全に、かつ確実に成果を出すための最新の対策ポイントを解説します。

【無料資料】カスタマーサポートのAI活用は二極化 差をつける一歩とは?

AIを使いこなして成果を出す企業と、リスクを前に足踏みする企業。その決定的な違いはどこにあるのでしょうか? 本資料では、生成AIを顧客対応に導入して成果を上げた成功事例などを詳しく解説しています。

【目次】

- 導入前に知っておくべき、AIチャットボットの3つのデメリット

- なぜAIは嘘をつくのか?「ハルシネーション」が起きる仕組み

- 企業がハルシネーションを防ぐための「3つの完全対策」

- 自社FAQのみを参照!ハルシネーションを防ぐ「Tayori」のAIチャットボット

- 情報漏洩を防ぐセキュリティ対策のポイント

- まとめ:リスクを正しく理解し、安全なAIチャットボット選びを

- よくある質問

導入前に知っておくべき、AIチャットボットの3つのデメリット

生成AIチャットボットは、従来のシナリオ型(ルールベース型)に比べて柔軟で高度な対応が可能です。しかし、自由度が高い反面、企業利用においては無視できないリスクが3つ存在します。これらを正しく理解することが、安全な運用の第一歩です。

1. ハルシネーション(もっともらしい嘘)のリスク

最も警戒すべきなのが「ハルシネーション(幻覚)」です。これは、AIが事実に基づかない情報を、あたかも真実であるかのように堂々と回答してしまう現象を指します。

例えば、自社で提供していないサービス内容について質問された際、AIが過去の学習データから似たような情報を勝手に合成し、「可能です。料金は〇〇円です」と捏造した回答を生成してしまうことがあります。AIには「悪意」も「嘘をついている自覚」もありません。ただ、プログラムされた仕組みに従って、もっともらしい文章を生成した結果、事実と異なる内容が出力されてしまうのです。

2. 100%意図した通りの言い回しにするのが難しい

従来のチャットボットであれば、あらかじめ登録したテキストをそのまま表示させるため、一言一句マニュアル通りの案内が可能でした。

しかし、生成AIはユーザーの問いかけに応じて、その都度「新しい文章」を構成します。そのため、回答の核となる情報が正しくても、「です・ます」のニュアンスや言葉選びが、企業のブランドイメージや接客マニュアルと完璧に一致させることが難しいという側面があります。「この言葉だけは絶対に使ってほしくない」といった細かな制御には、高度な設定や工夫が必要です。

3. 機密情報の学習・漏洩リスク(セキュリティ)

一般消費者向けの無料AIチャットサービスを利用する場合、入力した内容がAIの「再学習」に利用される設定になっていることがあります。

もし従業員が「社外秘の新プロジェクト資料」や「顧客の個人情報」を入力してしまった場合、そのデータがAIの知識として取り込まれ、全く関係のない第三者(他社)がAIに質問した際の回答として出力されてしまうリスクがあります。企業が導入する際には、入力データが学習に利用されない「オプトアウト(学習拒否)」が保証された環境を選ぶことが不可欠です。

なぜAIは嘘をつくのか?「ハルシネーション」が起きる仕組み

「なぜ、賢いはずのAIがこんな見え透いた嘘をつくのか?」と疑問に思うかもしれません。その理由は、AIの頭脳であるLLM(大規模言語モデル)の構造にあります。

生成AI(LLM)は「確率的に正しい言葉」を繋げているだけ

ChatGPTなどの生成AIは、人間のように言葉の意味を「理解」して思考しているわけではありません。膨大なテキストデータを学習した結果、「ある単語の次に来る確率が最も高い単語は何か」を予測して繋げているに過ぎません。

例えば「日本の首都は?」と聞かれれば、統計的に「東京」という言葉が続く確率が圧倒的に高いため正解を出せますが、学習データにない未知の情報を問われると、それっぽい単語を繋ぎ合わせて、文法的に正しい「架空の物語」を生成してしまいます。これがハルシネーションの正体です。

汎用的なデータと自社独自のルールの「ズレ」

AIはインターネット上の膨大な一般知識を学習しています。しかし、企業個別のルール(例:弊社では返品は購入から10日以内、セール品は対象外など)までは知りません。

AIが自社のルールを知らない状態で質問を受けると、ネット上の一般的な情報(例:通常、返品は8日以内とされることが多い)を優先して答えてしまいます。この「一般的な正解」と「自社固有の正解」のズレが、企業にとっては「嘘の回答」となって現れるのです。

企業がハルシネーションを防ぐための「3つの完全対策」

仕組み上、AIの嘘を完全にゼロにすることは困難ですが、ビジネス実務において「問題ないレベル」にまで抑え込むことは、以下の3つの対策で十分に可能です。

1. 独自データを参照させる「RAG技術」を搭載したツールを選ぶ

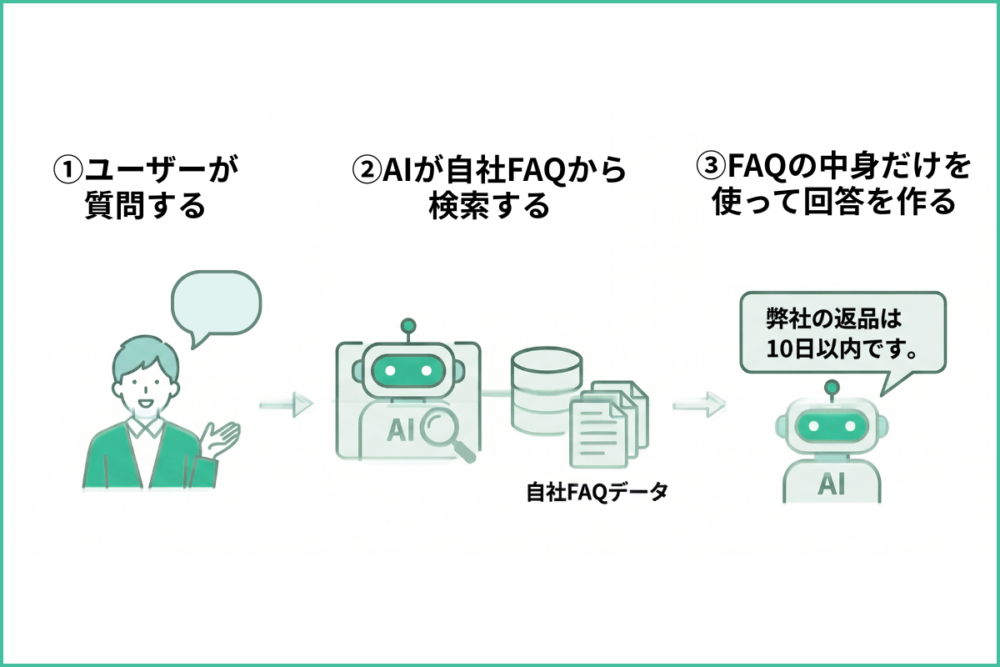

現在、企業がAIチャットボットを導入する際のスタンダードとなっているのが「RAG(Retrieval-Augmented Generation:検索拡張生成)」という技術です。

RAGとは、AIが回答を作る前に、まず「自社が用意したFAQやマニュアル」の中から関連する情報を検索し、その中身だけを参考にして回答を生成させる仕組みです。

この技術を使えば、AIは「自分の知っている一般知識」ではなく「目の前の資料(自社データ)」のみを根拠に話すよう制限されます。これにより、ハルシネーションのリスクを劇的に下げることが可能になります。

2. AIに読み込ませる「元データ(FAQ)」を常に最新にする

RAG技術を使っても、参照元となるデータが古ければ「正しい嘘(=古い情報の提示)」が発生します。AIの回答精度を維持するための命綱は、メンテナンスされたFAQやマニュアルです。

AIに正しい回答を生成させるためには、読み込ませるマニュアルやFAQの書き方にもコツがあります。詳細はこちらの記事「【Tayoriサポートからのおたより】AIに「伝わる」文章作成術!回答精度を劇的に上げる3つのコツ」をご覧ください。

3. 「わからない場合は有人対応に繋ぐ」エスカレーション導線を設ける

AIにすべての問題を解決させようとする「100%の自動化」は、かえってリスクを高めます。AIが参照データの中に答えを見つけられなかった場合、無理に回答させず「申し訳ございませんが、詳細を確認するためお問い合わせフォームよりご連絡ください」と案内させる設定が重要です。

適切なエスカレーション導線があれば、AIの不明瞭な回答による顧客の混乱を防ぎ、最終的な顧客満足度を担保できます。

自社FAQのみを参照!ハルシネーションを防ぐ「Tayori」のAIチャットボット

Tayoriなら、企業が登録したFAQの範囲内でのみ回答を生成し、参照元にない情報を勝手に推測して答えることはありません。

管理画面からFAQをアップロードするだけで、安全かつ高精度な自社専用AIが出来上がります。また、回答の末尾に「解決しなかった場合はこちら」と問い合わせフォームへのリンクを自動表示できるため、有人対応へのエスカレーションもスムーズです。

Tayoriの料金プランや活用シーンなどの詳細を知りたい方は、こちらのサービス紹介資料をご覧ください。

情報漏洩を防ぐセキュリティ対策のポイント

セキュリティ面での不安を解消するためには、ツール選びの際に「入力データの取り扱い」を必ずチェックしてください。

経済産業省・総務省が策定した「AI事業者ガイドライン」においても、企業におけるAI利用時のセキュリティ確保やプライバシー保護の重要性が強く説かれています。 公的機関がこうした指針を示す背景には、入力したデータが意図せずAIの学習に取り込まれてしまうリスクがあるからです。

ビジネス向けのAIチャットボットツールの多くは、API経由でAIモデルを利用しています。例えばTayoriでは、ユーザーや管理者が入力したデータをAIの再学習に利用しない「オプトアウト」の仕様を採用しています。これにより、社内情報や顧客とのやり取りがAIの知識として外部に漏れる心配はありません。

無料の「ChatGPT」などのAIツールをそのまま窓口業務に使うのではなく、こうしたプライバシー保護が明文化された「ビジネス向けツール」を選ぶことが、ガイドラインに沿った企業としての最低限のセキュリティラインとなります。

まとめ:リスクを正しく理解し、安全なAIチャットボット選びを

AIチャットボット、特に生成AIのデメリットは、仕組みを理解し適切なツールを選ぶことで十分にコントロール可能です。

・RAG技術で回答の根拠を自社データに限定する

・学習に利用されないビジネス向けツールを選ぶ

・FAQのメンテナンスと有人対応への導線をセットで考える

これらを押さえることで、ハルシネーションのリスクを極小化しながら、AIによる圧倒的な業務効率化の恩恵を受けることができます。

AIの回答精度を安全に育てながら、サポート品質の向上と業務効率化を両立させた事例『「丁寧に対応できる”余白”を」AIを育てて、問い合わせ50%減とサポート品質向上【テイクアンドギヴ・ニーズ】』をご覧ください。

AI活用で「差をつける側」へ。導入のヒントがここに

生成AIの導入を成功させる鍵は、正しいリスク管理と先行事例の参考にあります。 「カスタマーサポートのAI活用は二極化 差をつける一歩とは?」では、導入前に知っておきたい成功のポイントを解説しています。これからAI活用を本格化させたい方は、ぜひ参考にしてください。

よくある質問

ハルシネーションを100%完全にゼロにすることは可能ですか?

現在のAI技術において、ハルシネーションを完全に(0.00%に)封じ込めることは不可能です。しかし、自社データのみを参照させる「RAG」の活用や、プロンプトでの厳格な指示、定期的なFAQのメンテナンスにより、実務上問題のないレベルまで抑えることは十分に可能です。

無料のChatGPTをそのままカスタマーサポートに使えますか?

おすすめできません。入力データがAIの学習に利用され情報漏洩に繋がるリスクがあるほか、AIがネット上の不確かな情報を元に自社とは無関係な回答をしてしまう可能性が高いためです。顧客対応には、必ず法人向けにセキュリティが担保された専用ツールを利用してください。